All Posts

Every programmer makes errors. Therefore, learning to debug a program is an important part of learning to program. Another skill is learning to decipher cryptic error messages, which can be as hard to interpret as hieroglyphs. One helpful skill is learning to navigate a "traceback" error. A traceback error message

Wouldn’t it be great if we could create a Python environment with only the packages and versions we need? Enter: virtual environments.

Het data- en AI-platform SAS Viya 4 biedt krachtige voordelen: verbeterde prestaties, hogere productiviteit en meer vertrouwen. Dankzij de volledig cloud-native architectuur is het platform bovendien uiterst flexibel. Voor bestaande SAS-klanten is echter eerst een migratie nodig om optimaal te profiteren van deze voordelen. SAS-partner Notilyze faciliteert deze overgang op

A inteligência artificial (IA), em especial a generativa, tem sido cada vez mais usada por fraudadores para criar conteúdo falso, como deepfakes, para se passar por outras pessoas em esquemas fraudulentos. Criminosos estão desenvolvendo novos métodos e adaptando suas táticas de forma ágil – utilizando, inclusive, automação para perpetrar ataques em

UK banks are under growing pressure to manage risks more effectively, whether from economic shifts, technological advances or geopolitical uncertainty. The Bank of England’s Prudential Regulation Authority (PRA) sent a letter to the CEOs of UK deposit holders outlining its supervisory priorities for 2025. The letter sets expectations for stronger

Our eyes are a key sensory organ, allowing us to see and perceive the world around us. But, just like any other organ, they need proper care to stay healthy. In addition to regular eye exams and good hygiene, proper nutrition also plays a crucial role in maintaining vision and

No Dia Internacional do Pi (14/03), celebramos globalmente uma das constantes matemáticas mais fascinantes e presentes em nossas vidas. "O π transcende a matemática básica, ele está em praticamente tudo ao nosso redor", resume Taís Silva, do time de Customer Advisors do SAS e 'nerd', como ela mesma se define.

Zagadnienia związane z listami sankcyjnymi są obecne w życiu organizacji finansowych od wielu lat. Jednak to właśnie teraz nadszedł czas na przyjrzenie się, w jaki sposób temat ten jest zaadresowany zarówno pod kątem podejścia biznesowego, jak i zastosowanych algorytmów analitycznych. Ostatnie kilka lat to zmiana regulacji w Unii Europejskiej, co

PharmaSUG Japan SDE 2025が今年は対面で開催されます。 本イベントは、製薬・医療データに関する最新のトピックや実践的な知見を共有する絶好の機会です。 SAS Institute Japanもこのイベントに登壇し、臨床試験やリアルワールドデータの分析生産性と コラボレーションの強化についてご紹介いたします。ぜひご参加ください。 💡 開催概要 •日時:2025年4月7日(月)10:00-18:00 (9:30受付開始) •会場:中外製薬株式会社 •参加費:75 USD(Winter Webinar登録者は50 USD) •主なプログラム PharmaSUG SDE Japan 2025 – PharmaSUG •オープンソースとAIの活用 – 製薬業界における最新の技術動向 •CDISC標準の実務適用 – 規制対応に関する最新情報 •Japan Programming Head Councilによるパネルディスカッション – 業界課題と今後の展望 🔷SAS Institute Japan 講演 •登壇者: 土生 敏明 Sr Business Solutions Manager, Architecture & Platform Solution

As AI agents gain autonomy, who governs their actions? How do we ensure they align with human values, ethical standards, and legal frameworks? The urgency of governance for AI agents AI is no longer just a tool – it is becoming an actor in decision-making processes. From AI research assistants

Happy Pi Day! Every year on March 14th (written 3/14 in the US), people in the mathematical sciences celebrate "all things pi-related" because 3.14 is the three-decimal approximation to π ≈ 3.14159265358979.... The purpose of this day is to have fun, celebrate the importance of mathematics, and maybe learn a

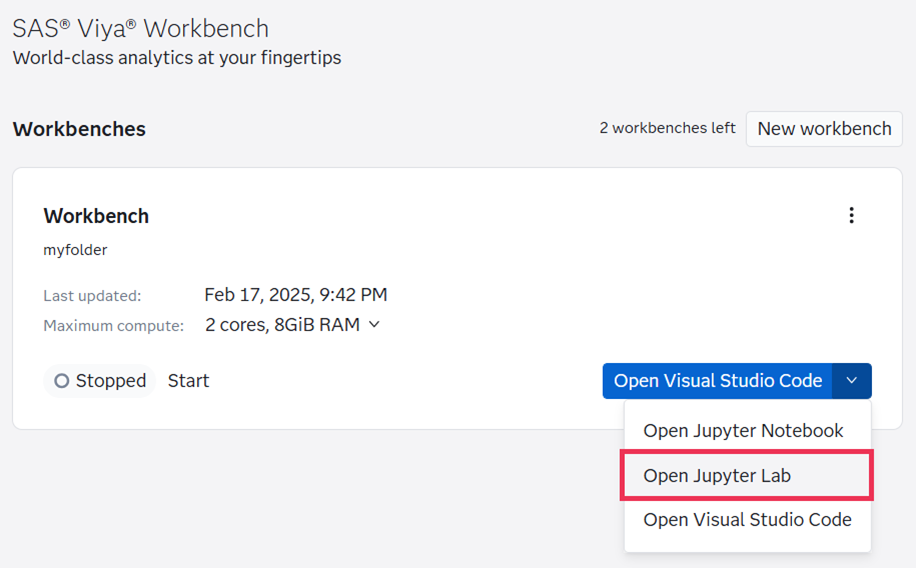

This article provides a step-by-step guide on manually installing VS Code extensions when access to the online marketplace is restricted, including downloading .vsix files from GitHub and handling dependencies.

AI agents are the tech trend of the moment. It is promising to reshape industries, streamline operations, enhance customer experiences and drive smarter decision-making in ways we couldn’t have imagined just a few years ago. As businesses, leaders, and innovators, it’s vital to understand how these systems actually function, not

Where were you when the global banking crisis of 2008 hit? I was in banking – marketing, to be specific – and I supported our mortgage department. I vividly recall our bank’s chief risk officer repeatedly refusing to enter the adjustable-rate mortgage subprime lending business. Many banks were eating our

AI is reshaping insurance – from streamlining underwriting and fraud detection to fighting climate risk.