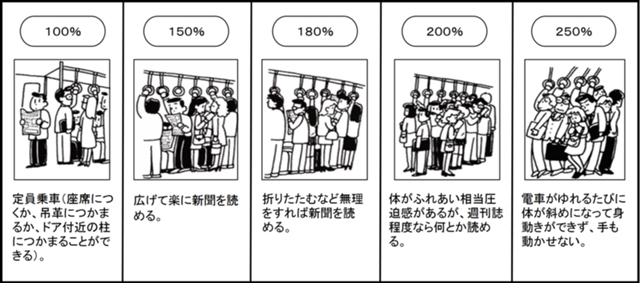

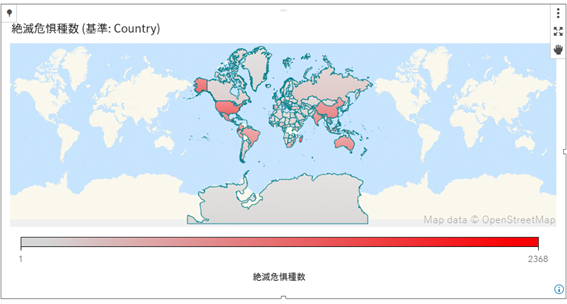

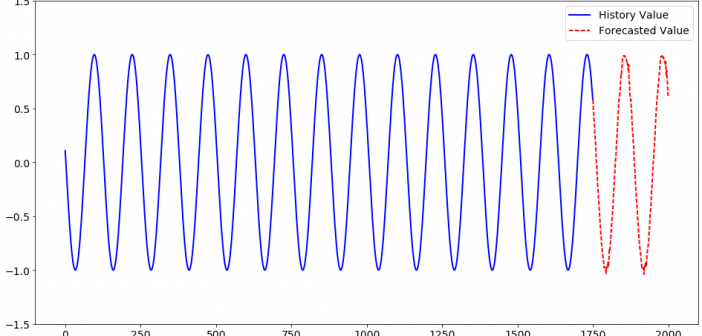

データサイエンティストを目指す学生向けのセミナー「データサイエンティストのキャリアと活躍のかたち」の第三回が3/19(火)に開催されました。第一回・第二回に引き続き今回も多くの学生の皆様に参加していただき、有意義なセミナーとなりました。本記事では、当日の様子についてご紹介します。 本セミナーでは、データサイエンティストのキャリアと活躍の場や、ビジネス上でのアナリティクス活用方法について、スピーカーがこれまでの経験をもとにご紹介しました。 SASにおけるデータサイエンティスト はじめに、データサイエンティストのキャリアやスキルについてSAS JapanのSebastian Wikanderより講演を行いました。 前半は、自身のキャリアや経験をもとにした、データサイエンティストのキャリアの紹介です。キャリアの初めはトラックメーカーに就職。様々なビジネスモデルをデータを用いて分析することに魅力とやりがいを感じ、SASに転職しました。SASでの仕事は年齢・学歴・国籍等、多様性があり、より良いパフォーマンスが発揮できます。具体的な仕事例として、大手IT企業の業務プロセス改善プロジェクトと部品メーカーにおけるディープラーニング活用プロジェクトを紹介し、SASと顧客のノウハウを合わせるチームワークの重要性や、過去の学びやスキルをもとに常に新しいチャレンジへと挑戦する楽しさなどを伝えました。 次に、データサイエンティストに必要なスキルの紹介です。核となるデータサイエンススキルの他にも、プログラミングスキル、統計学や機械学習の知識、ビジネス能力、英語力を含むコミュニケーションスキルなど多種多様なスキルが必要だとし、データサイエンティストは事例に合わせて最適なスキルを活用する「スペシャリストよりジェネラリスト」という言葉は印象的でした。 最後にデータサイエンティストのやりがいとして、様々なアプローチの中から一つを選択する「クリエイティブ」な側面、ビジネスとしての「人との関わり」という点、「新たなチャレンジ」を続けワクワクした日々を送れるという点を挙げ、より多くの学生に興味を持って欲しいというメッセージを伝えました。 アナリティクス活用領域の概要 リスク管理 続いて、リスク管理におけるアナリティクスの活用について、SAS Japanの柳による講演です。 最初にビジネスにおけるリスクについて紹介しました。リスクとは「不確実性」であると指摘し、その不確実性を想定の範囲内で「リスク管理」し「収益−損失の最大化」という目的を達成するためにアナリティクスが活用されていると紹介しました。 具体例として、金融機関における「規制対応のリスク管理」と「収益を上げるためのリスク管理」を挙げています。前者は政策等で一定の枠組みが決まっており事象の予測が行いやすく、アナリティクスが最大限活用されています。一方後者は変動が大きく様々なシナリオが想定されるため、経済情勢・社会情勢等に基づいた多様なモデルをもとにシミュレーションを重ね、意思決定の判断基準にしています。 最後に金融機関におけるAIの活用について紹介しました。業務の効率化や人的ミス排除等を目的とした従来のIT化とは異なり、人間では処理できないほど膨大となったデータを扱うために金融機関でAIを導入する動きが進んでいるとのことです。しかし、AIの思考がブラックボックス化され判断の説明可能性が低いという問題点もあり、AIの思考の透明性をどう保証するかが今後の大きな課題の一つであると伝えました。 SASの学生向けData Science 推進活動 最後に、学生のデータサイエンスの学びの場としてData for Good 勉強会とSAS Student Data for Good communityを紹介しました。Data for Goodとは様々な社会問題をデータを用いて解決する取り組みであり、これまでにも世界の絶滅危惧種や通勤ラッシュ時の鉄道混雑緩和をData for Goodの活動具体例として紹介しました。学生が主体となりこの活動をより推進するため、SASでは「Data for Good勉強会」と「SAS Student Data for Good Community」という活動を企画しています。 Data for Good 勉強会とは、SASやData Kind(Data for Goodを推進する社会団体)の実施したData